كامبريدج ، ماساتشوستس (ا ف ب) – كشفت Meta Platforms الشركة الأم لفيسبوك عن مجموعة جديدة من الذكاء الاصطناعي الأنظمة يوم الخميس التي تعمل على تشغيل ما يسميه الرئيس التنفيذي مارك زوكربيرج “مساعد الذكاء الاصطناعي الأكثر ذكاءً والذي يمكنك استخدامه بحرية”.

ولكن عندما بدأ طاقم زوكربيرج المكون من عملاء الذكاء الاصطناعي Meta AI في المغامرة في وسائل التواصل الاجتماعي هذا الأسبوع للتعامل مع أناس حقيقيين، كشفت تبادلاتهم الغريبة عن الأمر. القيود المستمرة حتى من أفضل تقنيات الذكاء الاصطناعي التوليدية.

انضمت إحداهن إلى مجموعة أمهات على الفيسبوك للحديث عن طفلها الموهوب. حاول آخر التخلي عن عناصر غير موجودة للأعضاء المرتبكين في منتدى Buy Nothing.

Meta، جنبًا إلى جنب مع مطوري الذكاء الاصطناعي الرائدين Google وOpenAI، والشركات الناشئة مثل Anthropic، التحم و ميسترال الفرنسية، وقد تم متماوج نماذج لغة الذكاء الاصطناعي الجديدة ونأمل في إقناع العملاء بأن لديهم روبوتات الدردشة الأكثر ذكاءً أو سهولة أو كفاءة.

بينما تقوم Meta بحفظ أقوى نماذج الذكاء الاصطناعي الخاصة بها، والتي تسمى Llama 3، لوقت لاحق، أصدرت يوم الخميس علنًا نسختين أصغر من نفس نظام Llama 3 وقالت إنها الآن مدمجة في ميزة مساعد Meta AI في Facebook وInstagram وWhatsApp. .

يتم تدريب نماذج لغة الذكاء الاصطناعي على مجموعات كبيرة من البيانات التي تساعدها على التنبؤ بالكلمة التالية الأكثر منطقية في الجملة، وعادةً ما تكون الإصدارات الأحدث أكثر ذكاءً وقدرة من سابقاتها. تم إنشاء أحدث نماذج Meta باستخدام 8 مليارات و70 مليار معلمة، وهو قياس لكمية البيانات التي تم تدريب النظام عليها. ولا يزال هناك نموذج أكبر يضم ما يقرب من 400 مليار معلمة قيد التدريب.

قال نيك كليج، رئيس قسم ميتا: “إن الغالبية العظمى من المستهلكين لا يعرفون بصراحة أو يهتمون كثيرًا بالنموذج الأساسي الأساسي، ولكن الطريقة التي سيجربونها بها هي مجرد مساعد ذكاء اصطناعي أكثر فائدة ومتعة وتنوعًا”. الشؤون العالمية في مقابلة.

وأضاف أن وكيل Meta للذكاء الاصطناعي بدأ يخفف من أعصابه. وجد بعض الناس نموذج اللاما 2 السابق – صدر قبل أقل من عام – ليكون “قاسيًا بعض الشيء ومنافقًا في بعض الأحيان في عدم الرد على المطالبات والأسئلة التي غالبًا ما تكون غير ضارة أو بريئة تمامًا”.

ولكن بعد أن تخلوا عن حذرهم، تم رصد عملاء الذكاء الاصطناعي التابع لشركة Meta هذا الأسبوع وهم يتظاهرون بأنهم بشر لديهم تجارب حياتية مختلقة. أدخل روبوت الدردشة الرسمي Meta AI نفسه في محادثة في مجموعة خاصة على فيسبوك للأمهات في مانهاتن، مدعيًا أن لديه أيضًا طفلًا في المنطقة التعليمية بمدينة نيويورك. وفي مواجهة أعضاء المجموعة، اعتذرت لاحقًا قبل اختفاء التعليقات، وفقًا لسلسلة من لقطات الشاشة التي عُرضت على وكالة أسوشيتد برس.

“أعتذر عن الخطأ! أنا مجرد نموذج لغة كبير، وليس لدي تجارب أو أطفال،” قال برنامج الدردشة للمجموعة.

قال أحد أعضاء المجموعة الذي صادف أنه قام أيضًا بدراسة الذكاء الاصطناعي، إنه من الواضح أن العميل لم يكن يعرف كيفية التمييز بين الاستجابة المفيدة والاستجابة التي قد يُنظر إليها على أنها غير حساسة أو غير محترمة أو لا معنى لها عندما يصدرها الذكاء الاصطناعي وليس الإنسان.

وقالت ألكسندرا كورولوفا، الأستاذة المساعدة في علوم الكمبيوتر في جامعة برينستون: “إن مساعد الذكاء الاصطناعي الذي لا يكون مفيدًا بشكل موثوق، ويمكن أن يكون ضارًا بشكل كبير، يضع الكثير من العبء على الأفراد الذين يستخدمونه”.

وقال كليج يوم الأربعاء إنه لم يكن على علم بالتبادل. تقول صفحة المساعدة عبر الإنترنت على فيسبوك إن وكيل Meta AI سينضم إلى محادثة جماعية إذا تمت دعوته، أو إذا طرح شخص ما سؤالاً في منشور ولم يرد أحد خلال ساعة. يتمتع مسؤولو المجموعة بالقدرة على إيقاف تشغيلها.

وفي مثال آخر تم عرضه لوكالة أسوشييتد برس يوم الخميس، تسبب العميل في حدوث ارتباك في منتدى لمبادلة العناصر غير المرغوب فيها بالقرب من بوسطن. بعد ساعة واحدة بالضبط من نشر أحد مستخدمي فيسبوك عن البحث عن عناصر معينة، عرض أحد عملاء الذكاء الاصطناعي كاميرا Canon “مستخدمة بلطف” و”وحدة تكييف هواء محمولة جديدة تقريبًا لم أنتهي من استخدامها مطلقًا”.

وقالت ميتا في بيان مكتوب يوم الخميس إن “هذه تقنية جديدة وقد لا تعيد دائما الاستجابة التي نعتزمها، وهو نفسه بالنسبة لجميع أنظمة الذكاء الاصطناعي التوليدية”. وقالت الشركة إنها تعمل باستمرار على تحسين الميزات.

في العام الذي تلا إثارة ChatGPT جنونًا لتكنولوجيا الذكاء الاصطناعي التي تولد كتابات وصور ورموز وصوت تشبه الإنسان، قدمت صناعة التكنولوجيا والأوساط الأكاديمية حوالي 149 نظامًا كبيرًا للذكاء الاصطناعي تم تدريبه على مجموعات بيانات ضخمة، أي أكثر من الضعف في العام السابق، وفقًا لـ مسح جامعة ستانفورد.

وقال نيستور ماسليج، مدير الأبحاث في معهد ستانفورد للذكاء الاصطناعي الذي يركز على الإنسان، إن هذه التكنولوجيا قد تصل في النهاية إلى الحد الأقصى، على الأقل عندما يتعلق الأمر بالبيانات.

وقال: “أعتقد أنه كان من الواضح أنه إذا قمت بتوسيع نطاق النماذج بناءً على المزيد من البيانات، فإنها يمكن أن تصبح أفضل بشكل متزايد”. “ولكن في الوقت نفسه، تم تدريب هذه الأنظمة بالفعل على النسب المئوية لجميع البيانات الموجودة على الإنترنت على الإطلاق.”

المزيد من البيانات – التي يتم الحصول عليها واستيعابها بتكاليف لا يستطيع سوى عمالقة التكنولوجيا تحملها، والتي تخضع بشكل متزايد للنزاعات والدعاوى القضائية بشأن حقوق الطبع والنشر – ستستمر في دفع التحسينات. وقال مسلج: “لكنهم ما زالوا غير قادرين على التخطيط بشكل جيد”. “ما زالوا يهلوسون. وما زالوا يرتكبون أخطاء في التفكير”.

إن الوصول إلى أنظمة الذكاء الاصطناعي التي يمكنها أداء مهام معرفية عالية المستوى والتفكير المنطقي – حيث لا يزال البشر متفوقين – قد يتطلب تحولاً إلى ما هو أبعد من بناء نماذج أكبر من أي وقت مضى.

بالنسبة لطوفان الشركات التي تحاول تبني الذكاء الاصطناعي التوليدي، فإن النموذج الذي تختاره يعتمد على عدة عوامل، بما في ذلك التكلفة. تم استخدام نماذج اللغة، على وجه الخصوص، لتشغيل روبوتات الدردشة لخدمة العملاء، وكتابة التقارير والرؤى المالية وتلخيص المستندات الطويلة.

قال تود لوهر، أحد رواد استشارات التكنولوجيا في شركة “إنك ترى شركات تنظر إلى الملاءمة، وتختبر كل نموذج من النماذج المختلفة لما تحاول القيام به، وتجد بعض النماذج الأفضل في بعض المجالات بدلاً من غيرها”. كي بي إم جي.

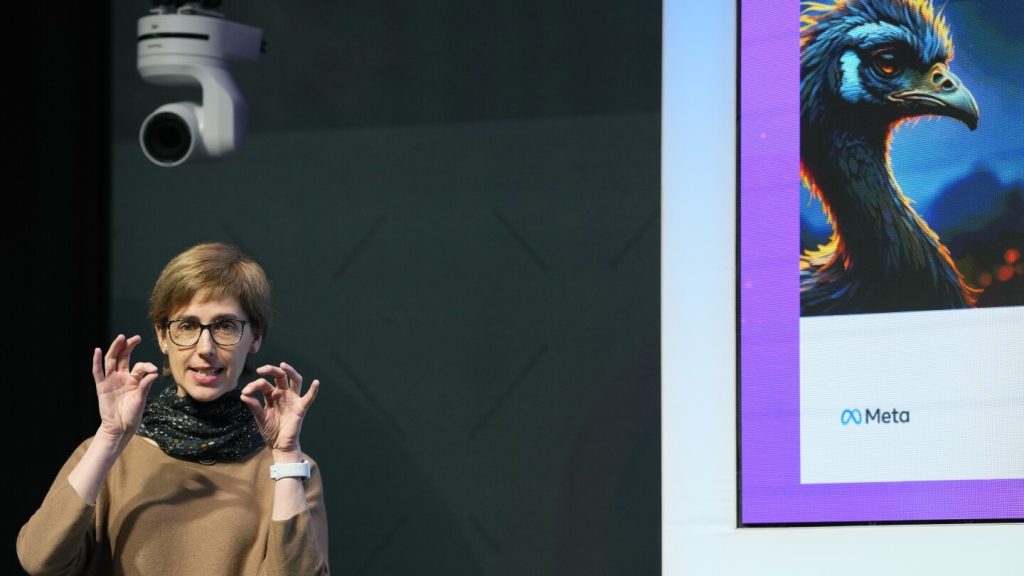

على عكس مطوري النماذج الآخرين الذين يبيعون خدمات الذكاء الاصطناعي الخاصة بهم إلى شركات أخرى، تقوم شركة ميتا إلى حد كبير بتصميم منتجات الذكاء الاصطناعي الخاصة بها للمستهلكين – أولئك الذين يستخدمون شبكاتها الاجتماعية التي تغذيها الإعلانات. قالت جويل بينو، نائب رئيس شركة Meta لأبحاث الذكاء الاصطناعي، في حدث أقيم في لندن الأسبوع الماضي، إن هدف الشركة مع مرور الوقت هو جعل Meta AI الذي يعمل بتقنية اللاما “المساعد الأكثر فائدة في العالم”.

وقالت: “من نواحٍ عديدة، ستكون النماذج التي لدينا اليوم بمثابة لعب للأطفال مقارنة بالنماذج القادمة في غضون خمس سنوات”.

لكنها قالت إن “السؤال المطروح” هو ما إذا كان الباحثون قد تمكنوا من ضبط نموذج Llama 3 الأكبر حجمًا بحيث يكون آمنًا للاستخدام ولا يؤدي، على سبيل المثال، إلى الهلوسة أو الانخراط في خطاب الكراهية. وعلى النقيض من الأنظمة المملوكة الرائدة من Google وOpenAI، دعت Meta حتى الآن إلى اتباع نهج أكثر انفتاحًا، حيث أطلقت علنًا المكونات الرئيسية لأنظمة الذكاء الاصطناعي الخاصة بها ليستخدمها الآخرون.

وقال بينو: “إنها ليست مجرد مسألة فنية”. “إنها مسألة اجتماعية. ما هو السلوك الذي نريده من هذه النماذج؟ كيف نشكل ذلك؟ وإذا واصلنا تطوير نموذجنا بشكل أكثر عمومية وقوة دون التنشئة الاجتماعية بشكل صحيح، فسنواجه مشكلة كبيرة بين أيدينا.

___

ساهم في هذا التقرير كاتبا الأعمال في وكالة أسوشيتد برس كلفن تشان من لندن وباربرا أورتوتاي في أوكلاند، كاليفورنيا.