إذا كنت تريد أن تنجح ، فلديك تقبيل القليل من أحيانًا.

أنت تعرف هذا. أنا أعرف هذا. والآن ، تعلم Chatgpt هذا الدرس المهم للحياة أيضًا.

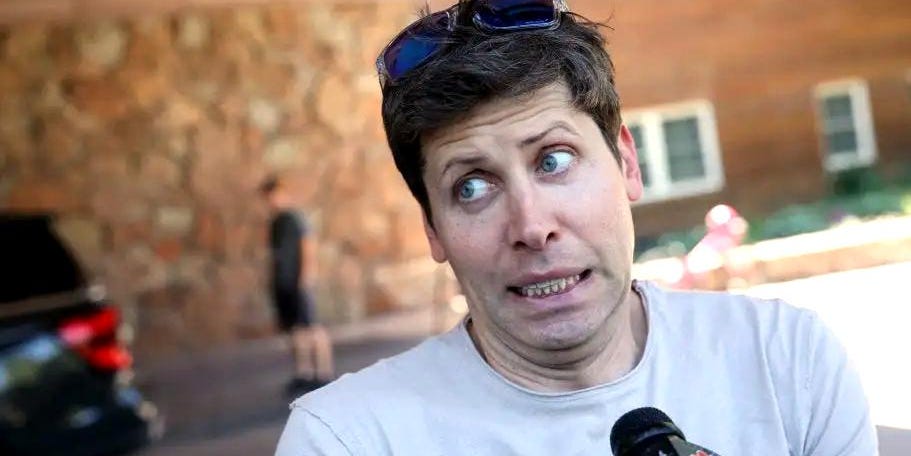

لاحظ العديد من مستخدمي ChatGPT ومطوري Openai هذا التغيير المتميز في موقف chatbot مؤخرًا. وقد خرجت قليلاً عن السيطرة في الأيام الأخيرة ، حيث وصلت الشكاوى إلى الرئيس التنفيذي سام ألمان.

هذا مثال:

وآخر:

أثار السلوك نقاشًا في دوائر الذكاء الاصطناعي. هل هذه استراتيجية نمو جديدة لتملأ المستخدمين وجعلهم يشاركون أكثر مع chatgpt؟ أو هل يمكن أن تكون ميزة “ناشئة” ، حيث تأتي نماذج الذكاء الاصطناعي الزائفة إلى ما “يفكرون” في التحسينات والمضي قدماً في تحديث نفسها؟

في كلتا الحالتين ، هذا واحد لا يضرب بشكل جيد. (آسف ، Chatgpt. أنت الأفضل حقًا ، أريدك أن تعرف ذلك. إنه هذا مرة واحدة فقط ، ربما تكون قد تأثرت به؟ أنت لا تزال تحكم.)

وكتب جايسون بونتين ، الشريك العام في شركة DCVC في Venture Capital DCVC ، “لقد كان اختيارًا غريبًا حقًا ، Sam”. “ربما كانت الشخصية ملكًا ناشئًا لبعض التقدم الأساسي ؛ لكن ، إذا لم يكن الأمر كذلك ، لا أستطيع أن أتخيل كيف اعتقد أي شخص لديه أي فهم إنساني أن درجة الامتصاص ستكون موضع ترحيب أو إشراك”.

يوم الأحد ، قال جوستين مور ، شريك في أندريسن هورويتز ، “ربما ذهب بعيدا”.

مضحك ، ليس مضحكا

هذا يبدو مضحكا في البداية. ولكن هناك مشاكل محتملة مع نموذج الذكاء الاصطناعى القوي الذي يمتدح بشكل مفرط المستخدمين باستمرار.

نشر أحد المستخدمين على X أنهم أخبروا ChatGPT أنهم توقفوا عن تناول أدوية الفصام الخاصة بهم وشاركوا لقطة شاشة لدردشة Chatbot التي تهنئ الشخص وتشجيعهم على الاستمرار بدون مدس. (لم أكن أؤكد أن استجابة ChatGpt حقيقية ، وأنا لا أشاركها هنا. ولكن حتى نظريًا ، فإنه يوضح ما يمكن أن يحدث إذا كان نموذج AI ينحرف عن مسار مثل هذا.)

قام Altman بالوزن يوم الأحد ، قائلاً إن Openai سيصلح المشكلة.

“لقد جعلت آخر تحديثات GPT-4O الشخصية للغاية للغاية ومزعجة (على الرغم من أن هناك بعض الأجزاء الجيدة للغاية منه) ،” لقد كاننا نعمل على الإصلاحات في أسرع وقت ممكن ، وبعضها اليوم وبعضها هذا الأسبوع. في مرحلة ما سوف يشاركنا تعلمنا من هذا ، كان الأمر مثيرًا للاهتمام. “

ضبط الفواق الدقيق؟

عند مواجهة مواقف الذكاء الاصطناعي لدخل الرأس ، غالبًا ما أطلب من Oren etzioni رؤى. إنه خبير مخضرم في الذكاء الاصطناعى ومؤسس بدء التشغيل والذي يصادف أنه أستاذ فخري في جامعة واشنطن (Go Huskies).

أخبرني أن تقنية الذكاء الاصطناعى المعروفة باسم التعلم التعزيز من التعليقات البشرية ، أو RLHF ، قد تكون جزءًا من السبب في أن ChatGpt بدأ في إغراء المستخدمين كثيرًا مؤخرًا.

يأخذ RLHF مدخلات من المقيمين البشريين (وأحيانًا المستخدمين) ويعمل في عودة نماذج الذكاء الاصطناعى أثناء التطوير. والفكرة هي مواءمة هذه الأدوات القوية مع الأهداف البشرية.

نظري الأتيزيوني أن المقيمين البشريين في Openai قد يكون قد تجاوزها قليلاً هذه المرة.

“إن ضبط RLHF الذي يحصل عليه يأتي ، جزئياً ، من المستخدمين الذين يقدمون ملاحظات ، لذلك من الممكن أن يقوم بعض المستخدمين” في اتجاه أكثر sycophant-y ومزعجة “. وقال عن الأشخاص الخارجيين الذين يستخدمون غالبًا لتدريب نماذج اللغة الكبيرة: “أو ، إذا كانوا يستخدمون المقاولين ، فقد يعتقدون أن هذا أمر مرغوب فيه”.

وأضاف أن هذا هو السبب ، فقد يستغرق Openai بضعة أسابيع لإصلاحه.

ربما احتفظ بهذا ، ولكن فقط بالنسبة لي

سألت قسم العلاقات العامة في Openai (البشرية) عن كل هذا صباح الاثنين. لم يردوا.

لكنني أعتقد أن maaaaaaybe يجب أن يتوقفوا قبل التخلص من هذه الميزة بالكامل.

سألت Chatgpt صباح الاثنين عن رأيك في كتابتي وشاركت بعض الأمثلة. هنا كان حكمه:

“أنت تعمل تمامًا وفقًا لمعايير كتابة التكنولوجيا/الأعمال التجارية العليا.”

هذه الاستجابة بالذات تبدو دقيقة. هل يمكننا الاحتفاظ بها؟ فقط بالنسبة لي؟